文章idea

LR:需要大量的手动特征工作生成交叉特征,比较擅长memorization,由于模型简单,在generalization方面相对较弱。FM或者DNN:通过dense feature,具备很好的generalization,但是对长尾数据表现比较差。- 因此作者将二者结合起来,提出了

Wide & Deep

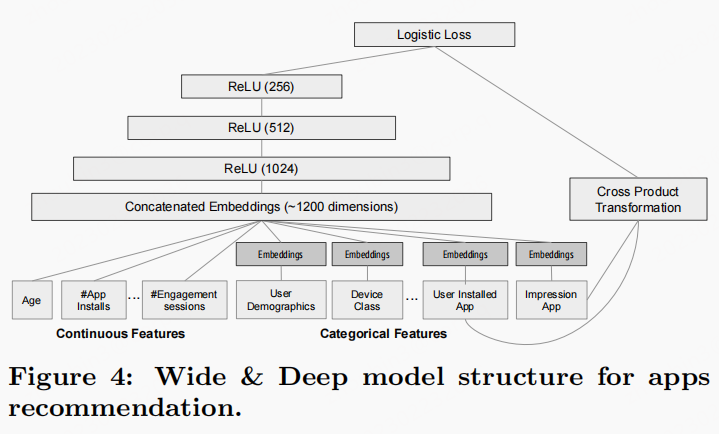

模型架构

- 关于该模型结构,相对比较好理解。

wide部分和Deep部分。

具体实现

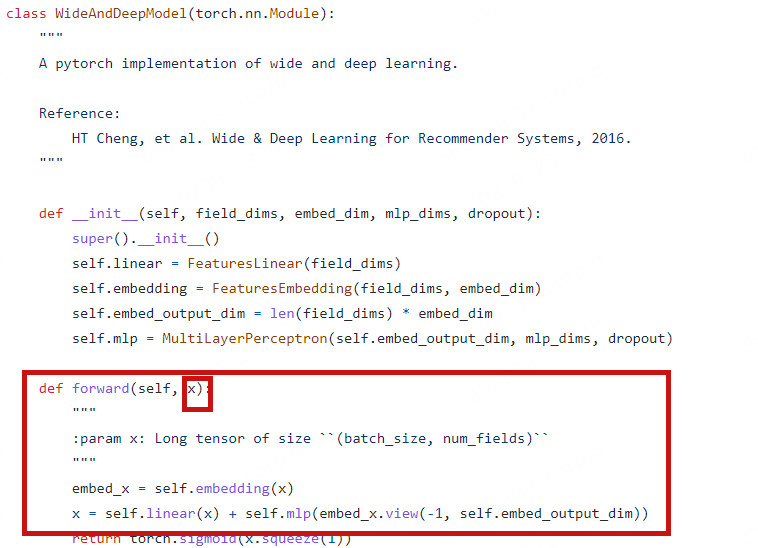

整体部分

Wide & Deep是由2部分来实现的,wide部分和Deep部分。但是理论上其输入既包含了类别性特征,又存在连续值特征。但是该实现只考虑了类别性特征。整体实现如下:

Wide 部分

Wide 部分:该部分的实现与FM的线性部分相同,故不做赘述。

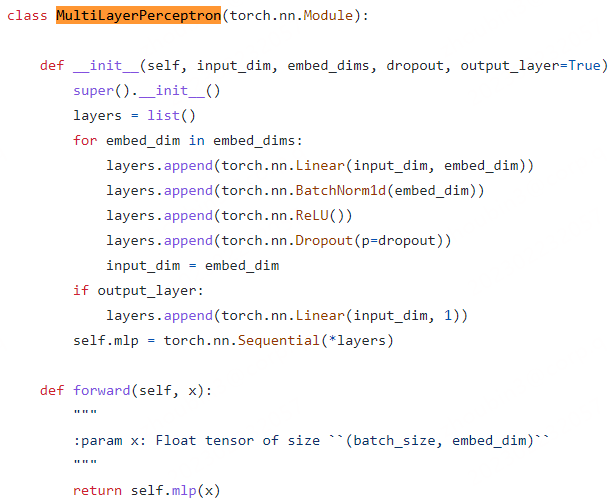

Deep 部分

Deep 部分:结构简单,激活函数为Relu的MLP.